Politische Vorhersage geschieht heute unter Zuhilfenahme künstlicher Intelligenz (KI). Hätte Political Prediction mit Einsatz eines starken Algorithmus die Regierungskrise in Österreich vorhersehen müssen?

PAUL FEIGELFELD: Dazu hätte es keinen besonderen Algorithmus gebraucht.

MARLIES WIRTH: Vorhersagealgorithmen machen außerdem eher Political Production. Fake-Profile, die Wirklichkeiten herstellen und Stimmung machen. Sehr problematisch!

Damit kommen wir gleich zu den Werten, die im Ausstellungstitel "Uncanny Values", unheimliche Werte, enthalten sind. Welche sind vor und mit KI zu schützen?

FEIGELFELD: Neutralität von Technologie ist nicht gegeben. Es geht daher darum, wie bei Daten, ihrer Kontrolle und Monetarisierung die Privatsphäre der Bürger und Regeln beachtet werden. Das Ausmaß von Technologie und künstlicher Intelligenz ist so weit fortgeschritten, dass niemand sagen kann, es betrifft ihn nicht. Daher ist wichtig, dass man partizipiert. Das bloße Nutzen von KI ohne diese Teilhabe ist gefährlich.

Derzeit steht KI mit Maschinenlernen auf relativ einfacher Stufe, der nächste Level ist das Erfassen und Generieren von Emotionen und Sprache in Verbindung mit Gefühlen.

WIRTH: Die Künstlerin Lynn Hershman Leeson zeigt dazu tiefer gehend einen interaktiven Sprachassistenten und einen "Emotional Barometer" aus Personendaten und Texteingaben. Jonas Lund lässt die Besucher mit einem "Significant Other" korrespondieren, einem Gegenüber in der Kunsthalle Wien, sowie mit einem Sprachbot wie Siri, der aber nach dem Künstler selbst gemodelt ist.

FEIGELFELD: Der erste Chatbot, Eliza, aus dem Jahr 1966 hat schon erstaunliche Ergebnisse geliefert. Er wurde von einem Psychotherapeuten modelliert.

WIRTH: Das weist auf Sigmund Freud, der 1919 über das Unbewusste, das Unvertraute geschrieben hat. Wir wissen ja selbst nicht, wie Intelligenz funktioniert. Wenn Technologie im Drei-Stunden-Durchlauf Muster besser erkennt als Wissenschaftler in Jahrzehnten, ist das auch unheimlich, eben wie das Unvertraute im Vertrauten.

Damit sind wir beim Begriff Uncanny, der von „Uncanny Valley“ aus der Robotik- und Statistikforschung stammt.

FEIGELFELD: Der japanische Robotiker Masahiro Mori hat 1970 den Begriff des „unheimlichen Tals“ geprägt. Er beschreibt die steigende Unsicherheit gegenüber Robotern, je menschenähnlicher sie sind.

Das Unheimliche bei KI ergibt sich daraus, dass nur Softwareentwickler verstehen, was abläuft. Programmieren ist wenigen Spezialisten vorbehalten.

FEIGELFELD: Als studierter Informatiker sage ich: Es schreit zum Himmel, dass die Spezialisten in keiner Weise ausgebildet werden über gesellschaftliche, soziale und kulturelle Relevanz. Sie sind reine Ingenieure. So sind ein Algorithmus und eine Atombombe ein interessantes Ingenieursproblem, nachgedacht wird erst danach.

Bei welchen besonders gesellschaftsrelevanten Themen stellt Kunst auf der Vienna Biennale 2019 KI auf den Prüfstand?

WIRTH: Viele Künstler und Designer, deren Arbeiten wir zum Teil auch in Auftrag gegeben haben, beschäftigen sich stark mit Ökologie und Klimaschutz. Was würde künstliche Intelligenz, wenn wir die Verantwortung an sie abgeben würden, tun, um positiv für das Klima zu wirken? In einer Live-Videoinstallation wird der Planet umgebaut. Da könnten nicht nachhaltige Städte wie Singapur oder Dubai von der Landkarte verschwinden. Oder KI greift gegen Flussregulierungen ein, um Arten zu schützen, das sieht man dann hier von Satellitenbildern aus.

Auf der Kunstbiennale in Venedig beschäftigt sich eine der interessantesten Video-Installationen mit Vorhersage des Wachstums eines blühenden Gartens. Die Künstlerin Hito Steyerl sagt, die Natur ist für KI zu komplex.

FEIGELFELD: Der Diskurs Vorhersagbarkeit oder nicht hat ein enormes theistisches Potenzial – bis zum Schöpfungsgedanken.

Zum Beispiel bei Biogenics, wo KI die DNA des Menschen neu erfindet. Wo zieht man bei den vielen medizinischen Fortschritten einmal Grenzen?

FEIGELFELD: Meine Einschätzung als Medienhistoriker ist: Alles, was implementiert werden kann, wird implementiert werden. Ethische Entscheidungen werden oft erst hinterher getroffen. Diese Dinge passieren.

In den USA schwelt eine heftige Diskussion über rassistische Aspekte bei der KI-Anwendung bei Gesichtserkennung allein wegen der Hautfarbe. An der Debatte beteiligt sich Europa gar nicht.

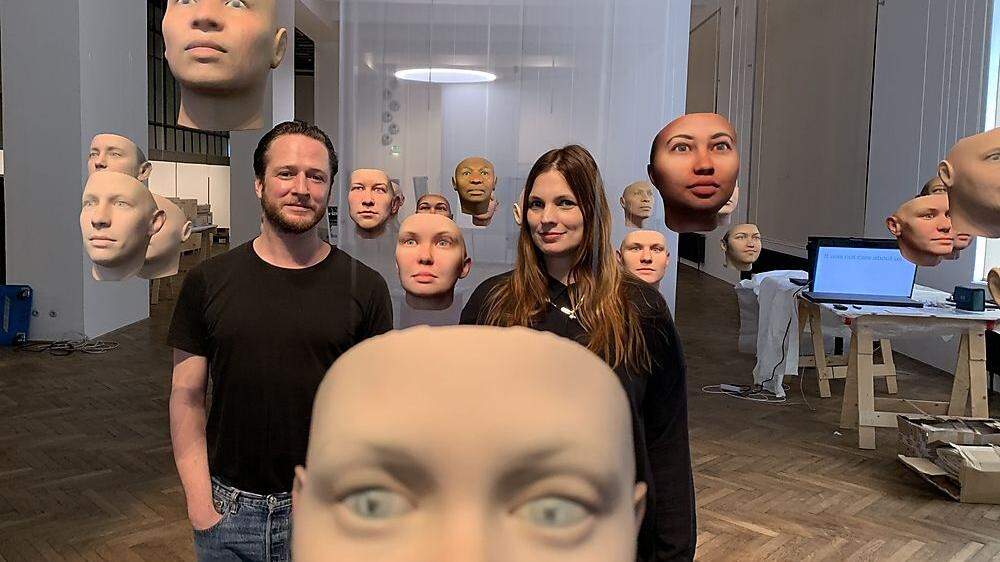

WIRTH: Gesichtserkennung macht die Ausstellung mit einer Installation von Heather Dewey-Hagborg und Chelsea E. Manning zum Thema. Mit Porträts, die KI anhand der DNA der Täter von einem Tatort entwirft. Die Installation zeigt, wie 30 Personen nach Größe, Hautfarbe und Gesicht aussehen könnten.

Welchen besonderen Blickwinkel auf KI schafft Kunst?

FEIGELFELD: Kunst ist eines der interessantesten Werkzeuge für die künstliche Intelligenz, weil sie selbst künstliche Intelligenz ist, als "last refuge of a scoundrel", ein letzter Schlupfwinkel. Als Anwender von KI-Technologie sorgt die Kunst für Transparenz, während KI sonst oft der Kontrolle und Machtverschleierung dient. Hier werden Bilder entschleiert, die uns die KI vermeintlich zum Verzücken liefert.

WIRTH: Die hinter der KI stehenden bildgebenden Techniken kommen häufig über die Kultur, so wie auch der Switch von der analogen zur digitalen Fotografie. Der neuseeländische Künstler Mladen Bizumic, der in Wien lebt, beschäftigt sich mit dem Erfinder des Scanners, dessen Frau hochauflösende Bilder von Kunstwerken benötigte. Wie immer wurde dann von Militär und Medizin Geld hineingepumpt, um diese Entwicklung zu nutzen.

Ein weites Feld für KI ist Gaming, Spiele, die jeder am Handy hat, um seine Zeit buchstäblich zu verspielen. Sie spielen mit KI-generierten Emojis darauf an?

FEIGELFELD: Emojis wurden erfunden, um im Chat die fehlende Person sichtbar zu machen. Unser AImoji nimmt Kommunikation als Einladung zur Ausstellung auf, die auch die Website thispersondoesnotexist.com zeigt, die Gesichter von Personen generiert, die es nicht gibt.

Vienna Biennale 2019

Das MAK, Museum für Angewandte Kunst in Wien, zeigt ab 29. Mai im Rahmen der Vienna Biennale 2019 die Ausstellung "Uncanny Values – Künstliche Intelligenz & Du".

Verantwortliche Kuratoren sind:

Marlies Wirth, Kuratorin für digitale Kultur und Leiterin der Sammlung Design;

Paul Feigelfeld, Medientheoretiker und Informatiker